Nuovi vettori di attacco per l’IA

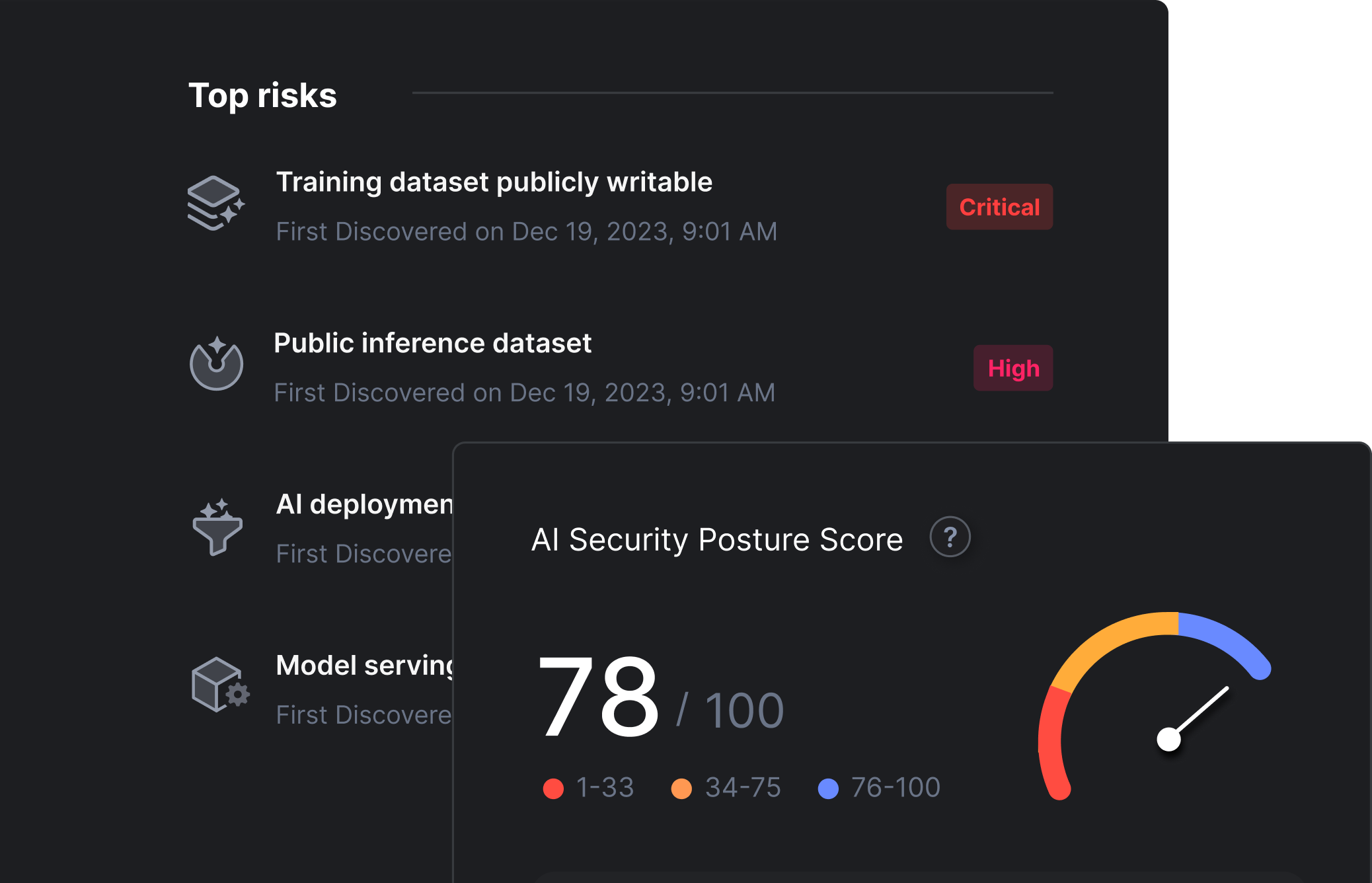

Le organizzazioni sono suscettibili a nuovi attacchi perché implementano nuove pipeline e infrastrutture e non hanno una visione unificata.

Nuovi vettori di attacco per l’IA

Le organizzazioni sono suscettibili a nuovi attacchi perché implementano nuove pipeline e infrastrutture e non hanno una visione unificata.

Problemi di proliferazione dei modelli

La mancanza di un inventario dell'IA può portare a modelli di shadow IA, violazioni della conformità ed esfiltrazione di dati tramite applicazioni basate sull'intelligenza artificiale.

Gestione carente

La nuova governance incentrata sull'intelligenza artificiale impone controlli rigorosi sull'utilizzo dell'IA e sui dati dei clienti che vengono inseriti nelle applicazioni basate sull'intelligenza artificiale.

Approfitta al massimo dei vantaggi trasformativi dell'intelligenza artificiale e dei modelli linguistici di grandi dimensioni (LLM) senza mettere a rischio la tua organizzazione. Prisma® Cloud AI Security Posture Management (AI-SPM) ti offre visibilità e controllo sui tre componenti critici per la sicurezza AI: i dati che usi per l'addestramento o l'inferenza, l'integrità dei modelli di intelligenza artificiale e l'accesso ai modelli implementati.

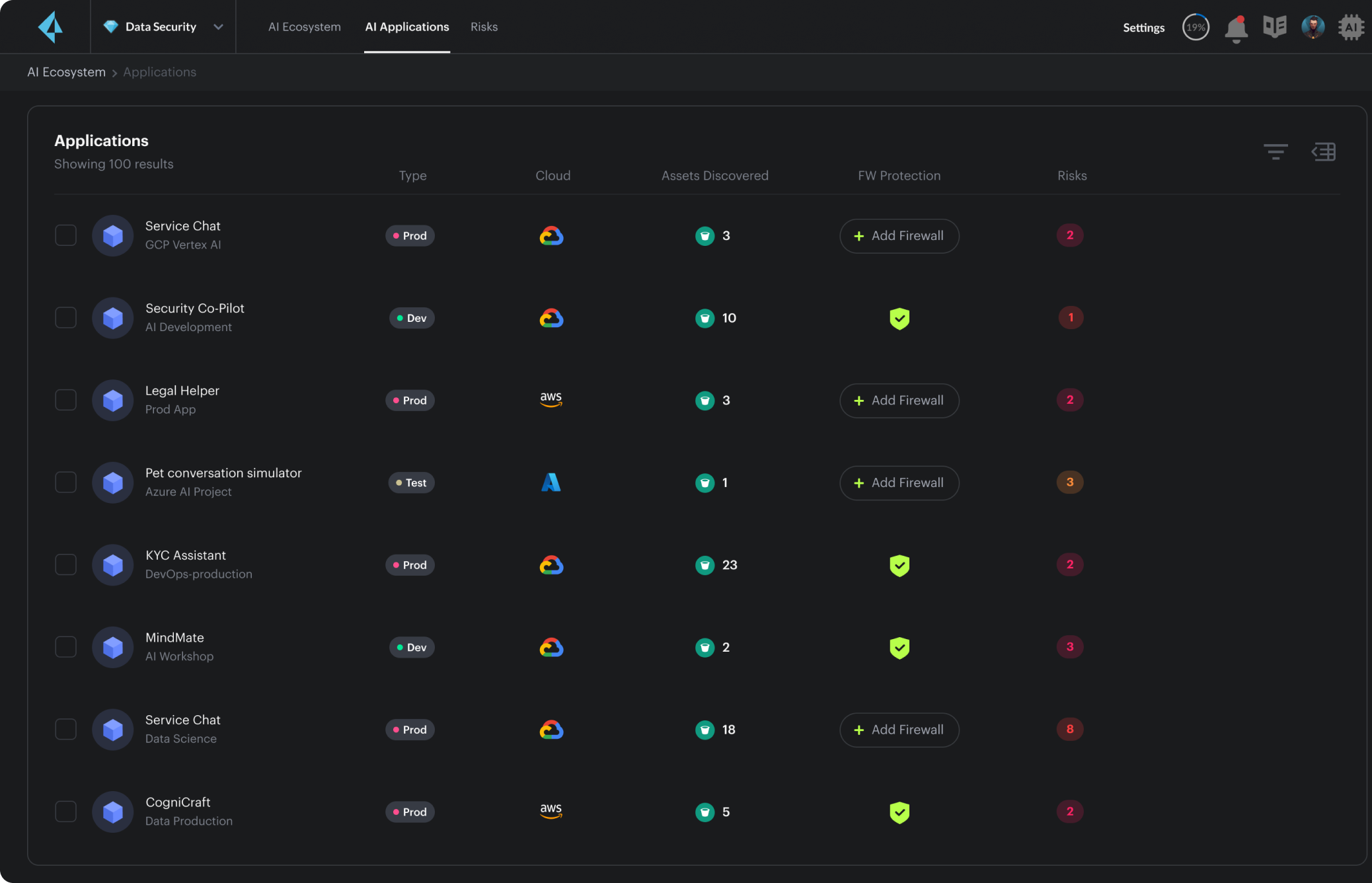

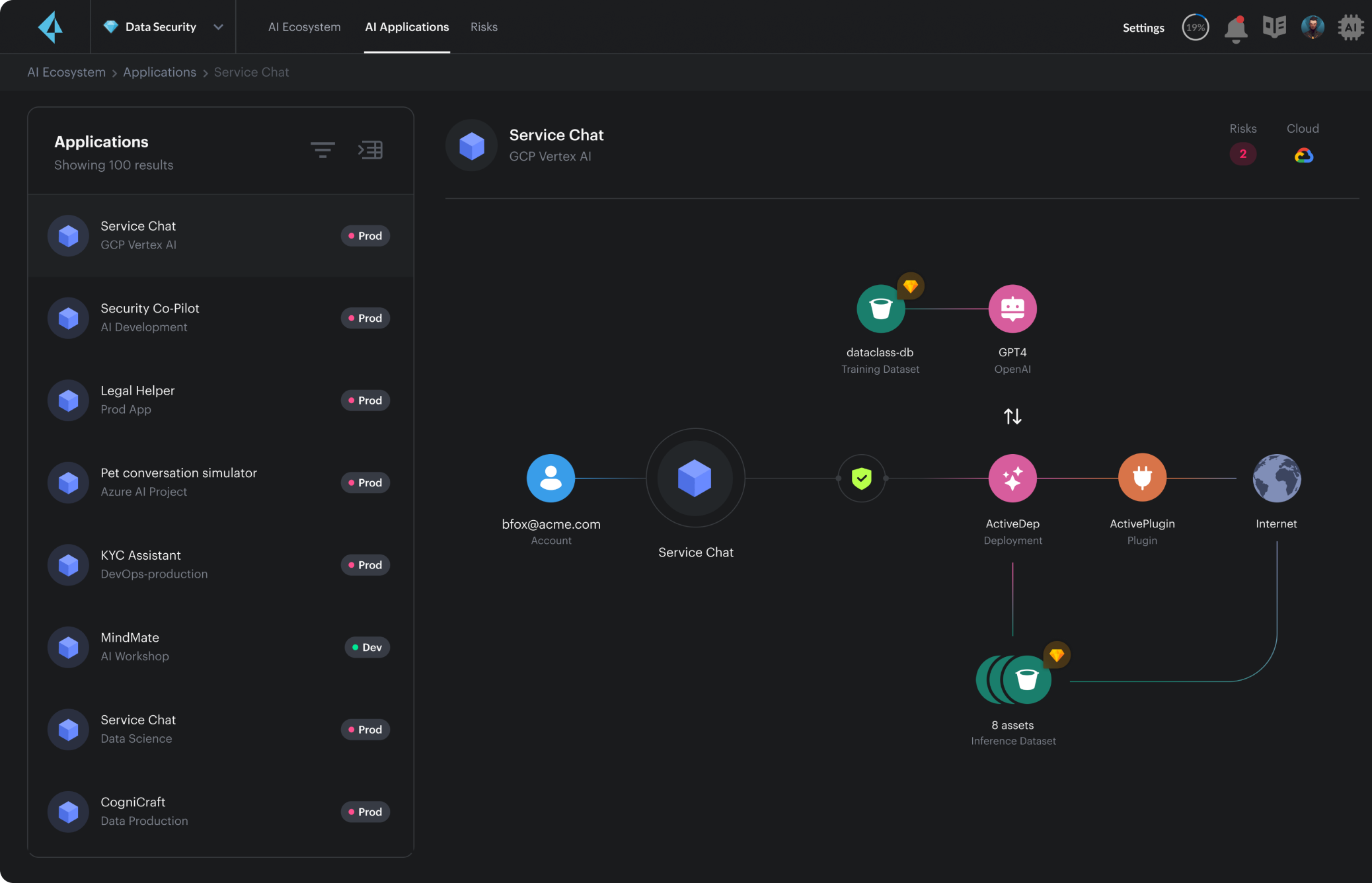

Scopri tutte le applicazioni, i modelli e le risorse associate all'IA. Identifica e traccia la genealogia dei componenti IA utilizzati nelle applicazioni.

Rilevamento dello stack di app IA

Scopri tutte le applicazioni, i modelli e le risorse associate all'IA.

Genealogia dell’IA

Identifica e traccia la genealogia dei componenti dell'IA e delle origini dei dati utilizzate nelle applicazioni.

Inventario dei modelli

Cataloga i modelli di intelligenza artificiale implementati e identifica gli aggiornamenti.

Identifica le vulnerabilità nella supply chain dell'IA e trova modelli non configurati correttamente e relative risorse cloud che possono portare a manipolazioni, usi impropri e furti.

Evita che il modello venga compromesso o rubato

Identificando i rischi degli avversari per creare un equivalente funzionale.

Individua le configurazioni errate

Riducendo modelli e istanze di elaborazione con privilegi eccessivi.

Progetta i plug-in in modo sicuro

Identificando agenti/carichi di lavoro con privilegi eccessivi e vulnerabili.

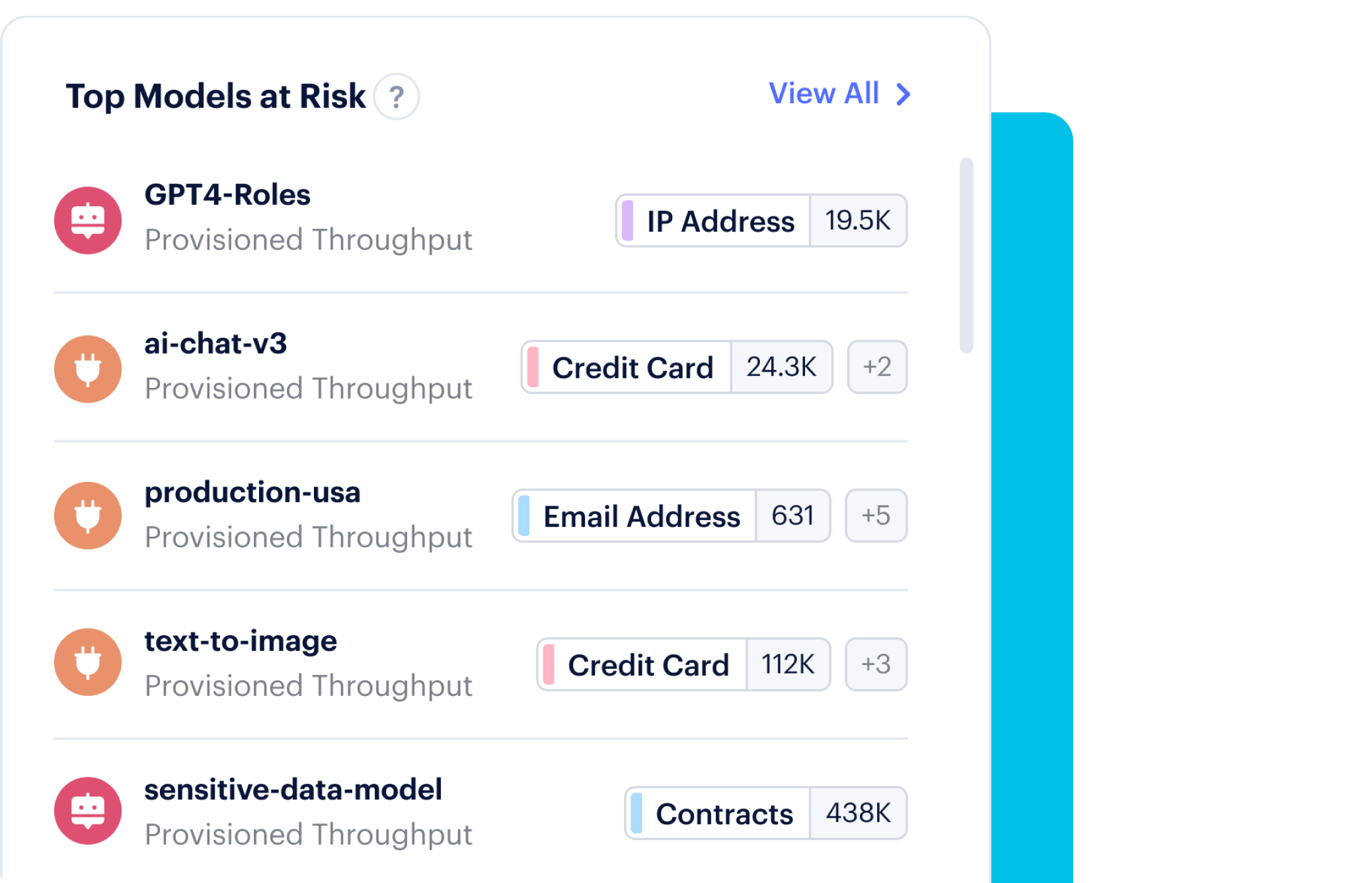

Se i dati dei modelli vengono manipolati si creano vulnerabilità e distorsioni, le informazioni vengono esposte e portando a violazioni della privacy dei dati, rischi di conformità e per la sicurezza.

Classifica lo stack di IA

Identifica le ubicazioni delle informazioni sensibili nei dati di addestramento e riferimento, nelle librerie, nelle API e nelle pipeline di dati che alimentano i modelli di intelligenza artificiale.

Monitora i dati sensibili

Monitora e regola l'esposizione dei dati, il rischio di contaminazione e le violazioni della privacy e della sicurezza.

Assegna priorità alle vulnerabilità

In un'infrastruttura che ospita una soluzione di IA con accesso a dati sensibili.